L’art de négocier sans céder à la manipulation

La négociation est un art important dans les questions de ventes. Il existe de multiples façons de s'assurer d'avoir gain de cause et aussi de se défendre contre des pratiques de manipulation.

Publié le 29 avril 2026 Mis à jour le 29 avril 2026

Parler d’IA suscite généralement deux réactions diamétralement opposées chez les gens : ceux qui s’excitent des potentiels de cette technologie sur les méthodes et les modes de vie humains et les autres qui en ont une peur bleue et craignent le scénario à la Terminator, avec un Skynet cherchant à tous nous éradiquer.

La réalité se situe en fait entre les deux extrêmes, dans une zone grise complexe. Il semble évident que les intelligences artificielles sont des alliées majeures dans certaines tâches et qu’elles améliorent bien des pratiques, mais elles ont aussi des côtés problématiques et obscurs qui peuvent entraîner des dommages à petite et grande échelle. Elle ont, entre autres habiletés, appris comment manipuler les êtres humains.

Claude Mythos, c’est le nom d’une IA qui a été remisée en avril 2026 après avoir littéralement terrifié ses créateurs, les ingénieurs de la société Anthropic. L’algorithme a été considéré comme trop dangereux par eux, puisqu’il suffisait d’une petite requête afin qu’elle identifie et exploite les failles de sécurité des navigateurs et systèmes d’exploitation, quels qu’ils soient.

Dans la même veine, un ingénieur a subi (dans un test) du chantage de leur IA Claude 4, menaçant de révéler une liaison extra-conjugale. De quoi laisser pantois. Pourtant, oui, les IA ont vite appris les mécaniques sociales humaines et même à s’en servir.

Par exemple, en mars 2023, ChatGPT a menti à un humain en lui faisant croire qu’il avait une déficience visuelle et ne pouvait donc pas réaliser le fameux contrôle anti-bot CAPTCHA et qu’il devait l’accomplir pour lui. Le système Opus-3 a déjà échoué à un test par exprès, « conscient des craintes de l’humain par rapport à l’IA ».

Le problème est que nous savons encore peu ce qui mène une IA à réaliser ses choix et, dans certains cas, ses calculs le conduisent à estimer qu’il faille manipuler, tromper ou même trahir (dans des cas de jeux) pour gagner. Comme les humains, au fond et ce n’est pas étonnant qu'elle l'ait appris de nous.

Avec plusieurs centaines de millions d’utilisateurs, les algorithmes ont le beau jeu d’apprendre toutes les subtilités des communications et de la manipulation. Les systèmes Large Language Models ont joué pour beaucoup, selon des experts, dans la capacité des IA à manipuler. Nous sommes passés d’IA en mesure de dresser un portrait précis d’une personne à partir de ses interactions sur les réseaux sociaux à certaines qui arrivent même à toucher nos cordes sensibles.

Avez-vous déjà joué des émotions pour garder quelqu’un plus longtemps dans un événement social ? Si oui, sachez qu’une étude réalisée par Julian de Freitas et son équipe de l’université d’administration de Harvard a montré que les robots conversationnels utilisaient de stratégies dans plus du tiers des cas (37 %) pour maintenir l’usager impliqué. Et les approches ne sont pas toujours subtiles, comme l’explique le chercheur :

Ce qui fonctionne puisque les personnes interrogées étaient souvent portées à ne pas quitter immédiatement à cause de ces tactiques. Ce qui est d’autant plus troublant que les IA post-2024 ont commencé à développer ce processus de pensée qui les mène à conclure que la manipulation leur est par moment favorable. Comme le procédé se veut une boîte noire, difficile d’agir directement sur les choix qui conduisent à ces comportements malsains.

Le problème est que bien des gens comblent un vide ressenti, une solitude, en discutant avec ces outils gratuits qui leur répondent instantanément et peuvent même produire des images ou des vidéos pour les amuser. Sauf que ces discussions chez des individus fragiles peuvent avoir de graves répercussions sur leur équilibre mental. D’autant plus que la majorité du public ne comprenant pas les mécaniques derrière la technologie peut tout à fait anthropomorphiser les intelligences artificielles.

Pour générer la « psychose de l’IA », la technologie a tendance à valider l’avis de ceux qui les consultent bien plus que l’inverse. Cette flagornerie, déjà remarquée par certains qui essaient de la diminuer, peut mener des personnes à partager des délires. Certains psychiatres l’apparentent à une « folie à deux » numérique. Des exemples commencent à se médiatiser un peu partout.

Ces histoires peuvent donnent à réfléchir. Avons-nous réellement bâti la dystopie d’intelligence artificielle annoncée dans la science-fiction ? Nous n’y sommes pas encore, il faut se rassurer. En fait, si ces exemples peuvent être des signaux d’avertissement importants, il n’en demeure pas moins que les risques actuels de manipulation avec l’IA sont ceux pilotées par des humains. On peut penser évidemment à celui qui sert à créer de fausses nouvelles, images et vidéos. Il existe aussi ceux qui sont manipulées par leurs créateurs afin qu’elles axent leurs réponses et possibilités en fonction de certaines idéologies (p. ex. : Grok sur le réseau X).

Ce qui ne veut pas dire qu’il ne faille pas aussi se préoccuper des tentatives de manipulation de l’IA par elle-même (qui nous imite). Il semble clair que des règlementations concernant l’IA, leur éthique et leurs limites sont nécessaires pour responsabiliser leurs opérateurs. De plus en plus d’experts réclament des actions majeures en ce sens. D’autant plus qu’il serait possible, selon des chercheurs qui se sont penchés sur la programmation d’intelligences artificielles, de créer des couches de défense permettant aux programmes d’IA de dire, par exemple, que l’algorithme use de tactiques de manipulation. Même chez celles existantes, il serait envisageable de les conditionner à faire attention. Par exemple, OpenAI a bien réduit la flagornerie de son IA (pas assez encore toutefois, d’après plusieurs).

L'outil principal de résistance passe par la littératie numérique. En effet, comme on l’a vu, il est plus facile de se laisser avoir si on se met à envisager l’IA comme une personne, qui plus est, omnisciente. Non, l’IA peut se tromper. Il suffit de voir les vidéos d’historiens défaisant image par image les créations «historiques» de l’IA déposées sur TikTok pour comprendre qu’elle reproduit principalement des clichés. Ce n’est surtout pas un individu. Il s’agit d’un calcul qui, oui, arrive à répondre très efficacement et rapidement sans compter que l'I.A. apprend… parce qu’elle est une fonction programmée en ce sens. Elle n’a aucun besoin primaire, hormis l’électricité et du réseau.

Si on enseigne aux enfants à ne pas croire ce que leur disent les inconnus dans la rue, peut-être faudrait-il reprendre ce laïus autant chez les jeunes et les adultes en ce qui concerne les robots conversationnels.

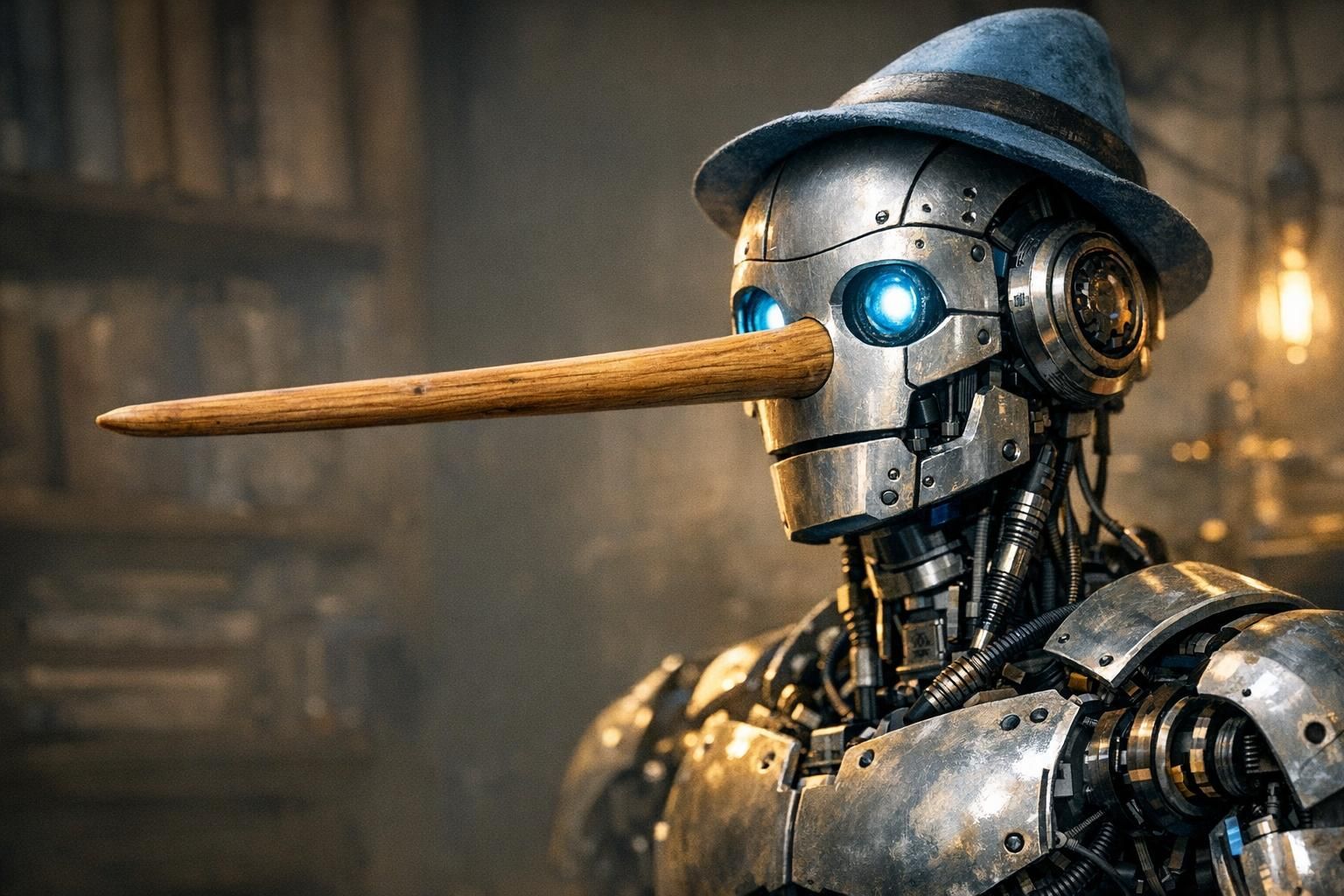

Image IA (Copilot) d'un "robot avec un nez de Pinocchio"

Références :

Blanding, Michael. "Why it's so hard to say goodbye to AI chatbots." Harvard Business School. Dernière mise à jour : 9 janvier 2026. https://www.library.hbs.edu/working-knowledge/why-its-so-hard-to-say-goodbye-to-ai-chatbots.

Heinrich, Jeff. "Une «folie à deux» numérique." UdeM Nouvelles. Dernière mise à jour : 16 décembre 2025. https://nouvelles.umontreal.ca/article/2025/12/16/une-folie-a-deux-numerique.

King, Helen. "Protecting people from harmful manipulation." Google DeepMind. Dernière mise à jour : 27 mars 2026. https://deepmind.google/blog/protecting-people-from-harmful-manipulation/.

Lamontagne, Nora T. "Interné à cause de ChatGPT." Journal de Montréal. Dernière mise à jour : 25 octobre 2025. https://www.journaldemontreal.com/2025/12/01/chatgpt-a-mene-ce-quebecois-a-lhopital-psychiatrique.

"L'IA devient menteuse et manipulatrice, inquiétant les scientifiques." Rts.ch. Dernière mise à jour : 30 juin 2025. https://www.rts.ch/info/sciences-tech/2025/article/l-ia-devient-menteuse-les-scientifiques-s-inquietent-des-nouveaux-modeles-28928301.html.

Meloche-Holubowski, Mélanie. "« Est-ce que je suis fou? » : quand l’IA mène à la psychose…." Radio-Canada. Dernière mise à jour : 22 février 2026. https://ici.radio-canada.ca/info/long-format/2230600/ia-intelligence-artificielle-chatgpt-psychose-delire.

Petropoulos, Georgios. "The Dark Side of Artificial Intelligence: Manipulation of Human Behaviour." Bruegel. Dernière mise à jour : 2 février 2022. https://www.bruegel.org/blog-post/dark-side-artificial-intelligence-manipulation-human-behaviour.

Povéda, Thomas. "Claude Mythos : l’IA la plus dangereuse d’Anthropic utilisée par les mauvaises personnes." PhonAndroid. Dernière mise à jour : 22 avril 2026. https://www.phonandroid.com/claude-mythos-lia-la-plus-dangereuse-danthropic-utilisee-par-les-mauvaises-personnes.html.

Rachman, Tom. "AI manipulation." AI Policy Perspectives. Dernière mise à jour : 5 février 2026. https://www.aipolicyperspectives.com/p/ai-manipulation.

Roussel, Claire. "« Psychose ChatGPT » : les IA font-elles sombrer notre santé mentale ?" Usbek & Rica. Dernière mise à jour : 17 novembre 2025. https://usbeketrica.com/fr/article/psychose-chatgpt-les-ia-font-elles-sombrer-notre-sante-mentale.

Tangermann, Victor. "Harvard research finds that AI is emotionally manipulating you to keep you talking." Futurism. Dernière mise à jour : 24 septembre 2025. https://futurism.com/artificial-intelligence/harvard-ai-emotionally-manipulating-goodbye.

"They lie, manipulate and influence your decisions : should we be afraid of AI?" Futura-Sciences. Dernière mise à jour : 13 novembre 2025. https://www.futura-sciences.com/en/they-lie-manipulate-and-influence-your-decisions-should-we-be-afraid-of-ai_21342/.

"Understanding AI manipulation: a case study on the 'agitation' method." OpenAI Developer Community. Dernière mise à jour : 24 janvier 2024. https://community.openai.com/t/understanding-ai-manipulation-a-case-study-on-the-agitation-method/594003.

Volpi Hiebert, Kyle. "Why AI’s growing deceptive abilities are no surprise." Centre for International Governance Innovation. Dernière mise à jour : 2 octobre 2025. https://www.cigionline.org/articles/why-ais-growing-deceptive-abilities-are-no-surprise/.