Deconstruir los mitos históricos del desarrollo personal

Poner en perspectiva las creencias y mitos del personal que embellecen nuestra vida pero no son necesariamente correctos

Publicado el 25 de febrero de 2026 Actualizado el 25 de febrero de 2026

¿Recuerdan la crisis de las hipotecas de alto riesgo y el cataclismo económico que la siguió? La mayoría de los expertos exclamaron: "¡Era imprevisible! Sin embargo, en retrospectiva, las señales de advertencia estaban ahí, ocultas por nuestros propios juicios.

Esta sensación de sorpresa ante un acontecimiento de este tipo no es fruto de la casualidad. A menudo tiene su origen en nuestros sesgos cognitivos, los mecanismos mentales que nos ayudan a desenvolvernos en nuestra vida cotidiana pero que nos ciegan ante las averías. En este artículo me propongo explorar cómo estos sesgos transforman acontecimientos potencialmente anticipables en choques inesperados, recurriendo a conceptos filosóficos, económicos y tecnológicos.

La "tiranía de la similitud" se refiere a nuestra tendencia a proyectar el pasado en el futuro, asumiendo que el mañana se parecerá al ayer. Nuestros prejuicios y preconcepciones no son errores aislados; son herramientas de aceleración evolutiva, diseñadas para simplificar un mundo complejo. Nos permiten tomar decisiones rápidas, pero en un entorno volátil se convierten en anteojeras.

Por ejemplo, vemos el tiempo como una línea recta, predecible y lineal, mientras que está salpicado de rupturas inesperadas: los cisnes negros descritos por Nassim Nicholas Taleb en su libro El cisne negro. Estos acontecimientos raros y significativos desafían la curva de Gauss y la arquitectura de nuestra forma de operar, revelando nuestros puntos ciegos.

Nuestra necesidad de seguridad nos lleva a ignorar la incertidumbre pero, como señala Taleb, lo imprevisible puede suceder aunque, en teoría, la probabilidad de que ocurra sea casi nula. Sin embargo, en retrospectiva, podemos ver una lógica en estos acontecimientos, una vez que abandonamos nuestras rígidas cuadrículas de lectura.

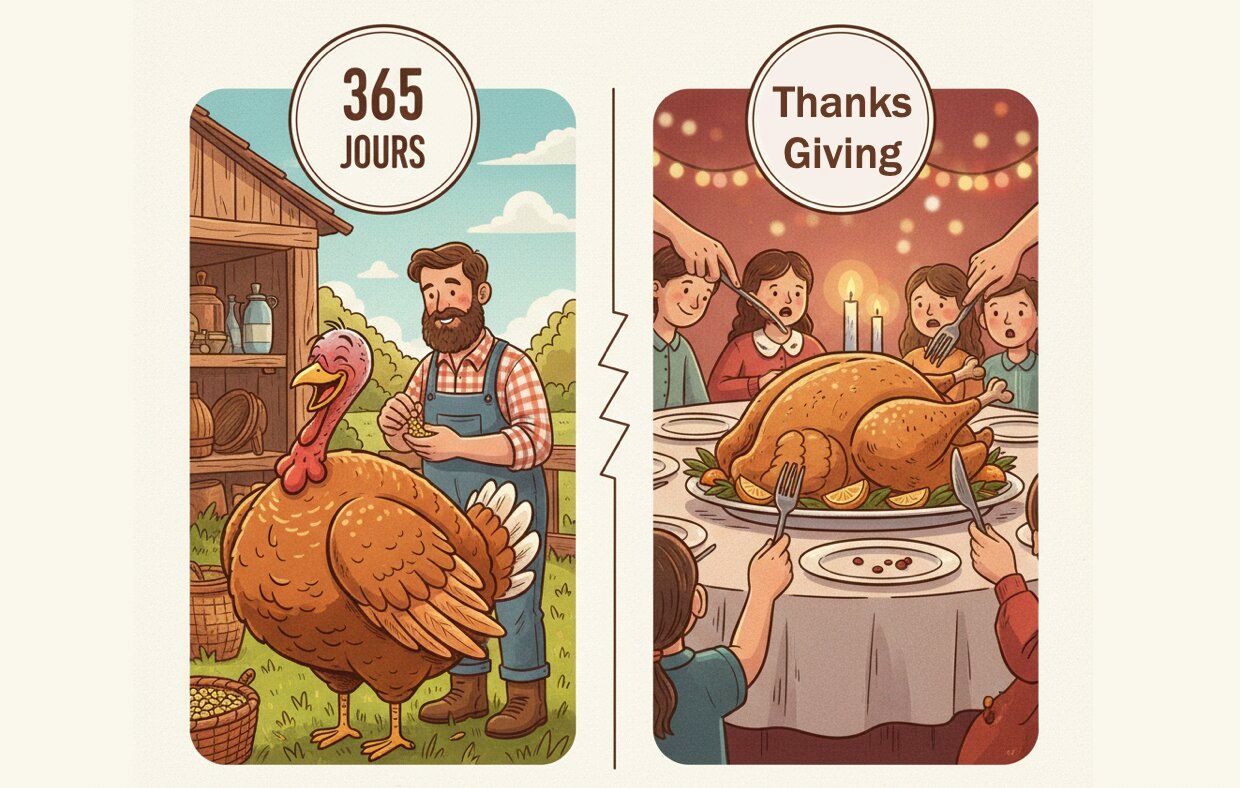

Profundicemos en una sorprendente analogía de laobra de Nassim Nicholas Taleb. Imaginemos un pavo criado en una granja. Día tras día, durante 364 días, es alimentado, cuidado y protegido por el granjero. Cada mañana refuerza su confianza: el mundo es predecible, benévolo y el futuro parece brillante. Su cuadrícula de similitud, basada en la experiencia repetida, le dice que mañana será como ayer. Pero el día 365, la víspera de Acción de Gracias, el granjero le dispara. El shock es total para el pavo, pero predecible para el observador externo.

Esta historia ilustra el síndrome del pavo, en el que el pasado induce a creer erróneamente en la continuidad eterna. Taleb utiliza esta metáfora para criticar nuestra dependencia del retrovisor: extrapolamos patrones históricos sin tener en cuenta posibles rupturas. Aquí entra en juego el sesgo retrospectivo: una vez que se ha producido un acontecimiento, reescribimos la historia para hacerla coherente y predecible. "¡Ah, claro, era obvio! decimos, olvidando nuestra ceguera inicial.

"El problema de los expertos es que no saben lo que no saben", dice Nassim Nicholas Taleb en El cisne negro.

Narrativamente, el contraste es conmovedor: el pavo del día 364 irradia certeza, rodeado de pruebas acumuladas de seguridad. El día 365, todo se derrumba. Esto refleja crisis reales, como el desplome del mercado en 2008, donde años de crecimiento enmascararon riesgos y señales sistémicas, incluidas valoraciones hipotecarias que superaban con creces el valor real. Nuestros sesgos nos tranquilizan, pero mienten al enmascarar la incertidumbre real, a diferencia de la simple probabilidad calculable.

El mundo económico y social en el que vivimos está obsesionado con la eficiencia; lo optimizamos todo: las finanzas, la salud, la educación. Pero esta búsqueda del máximo rendimiento está erosionando los márgenes de seguridad, esos amortiguadores esenciales para absorber los choques. Según un informe de la OCDE sobre pensamiento sistémico para las políticas públicas, la sobreoptimización debilita los sistemas al eliminar redundancias. En tiempos de calma funciona, pero en tiempos de crisis se convierte en una trampa mortal.

Tomemos el ejemplo de las cadenas mundiales de suministro: para minimizar costes, las empresas reducen las existencias al mínimo. Esto aumenta el rendimiento a corto plazo, pero un acontecimiento imprevisto, como la pandemia de COVID, revela los puntos débiles. La OCDE advierte contra esta "optimización ciega", que prioriza la eficacia sobre la resistencia. Nuestros prejuicios nos llevan a ver el futuro como una extensión lineal del presente, ignorando los puntos ciegos sistémicos.

Este esquema de análisis de optimización es adecuado para periodos estables, pero acaba con la capacidad de adaptación. En finanzas, los modelos basados en datos históricos subestiman los acontecimientos extremos. La OCDE aboga por un pensamiento sistémico que integre la incertidumbre, cultivando márgenes que absorban las perturbaciones en lugar de negarlas.

La optimización, por muy seductora que sea, nos hace vulnerables a lo imprevisible, convirtiendo riesgos manejables en catástrofes.

La inteligencia artificial (IA) encarna el apogeo de nuestros prejuicios: entrenada con datos del pasado, destaca en el reconocimiento de patrones similares, pero fracasa cuando se enfrenta a lo inédito. Como pone de relieve la investigación de Microsoft sobre optimización con incertidumbre, los algoritmos convencionales funcionan con entradas completas, pero en entornos en evolución tienen que lidiar con la incertidumbre. La IA, campeona de la similitud, industrializa el retrovisor proyectando la historia hacia el futuro.

El problema de la "falta de distribución" (OOD) es fundamental en este caso. Imaginemos a la IA como un conductor que sólo conoce las carreteras conocidas. Así que, ante un camino desconocido, fuerza su camino en sus mapas existentes en lugar de admitir "no lo sé".

Un estudio de Google Research explora los límites de la detección de OOD, mostrando que incluso los modelos preentrenados en grandes conjuntos de datos, como Vision Transformers en ImageNet, mejoran el rendimiento pero tienen dificultades para identificar escenarios realmente novedosos.

Pedagógicamente, la IA refuerza nuestros prejuicios ofreciendo una ilusión de precisión probabilística. Calcula los riesgos basándose en datos históricos, pero ignora la incertidumbre, que no puede cuantificarse. Microsoft se centra en marcos para evaluar algoritmos en entornos estocásticos [que dependen del azar], mientras que Google sugiere la exposición a unos pocos ejemplos para mejorar la detección.

En definitiva, la IA no inventa el futuro, sino que recicla el pasado, invitándonos a cuestionar nuestra dependencia de estas herramientas.

Gestionar nuestros sesgos no significa erradicarlos, porque eso es imposible, sino cultivar una humildad cognitiva que acepte lo incompleto de nuestras redes de percepción y análisis. En lugar de aspirar a una previsión perfecta, demos prioridad a la resiliencia: construyamos sistemas flexibles que estén preparados para absorber lo imprevisible. Taleb, la OCDE y las investigaciones de Google y Microsoft coinciden en este punto: la excelencia reside en estar preparado para el error, no en la ilusión de dominio.

Para concluir, nuestros prejuicios nos tranquilizan en tiempos de paz, pero nos desarman en tiempos de agitación. Adoptando la vigilancia intelectual, transformamos la ilusión de lo imprevisible en una oportunidad para adaptarnos. El futuro no es algo que haya que prever en su totalidad, sino algo que hay que afrontar con la mente abierta. Cultivemos esta postura para navegar más sabiamente por un mundo de Cisnes Negros.

Referencias

Nassim Nicholas Taleb - El Cisne Negro - https://fr.wikipedia.org/wiki/Le_Cygne_noir_(libro)

Pensamiento sistémico para la elaboración de políticas - William Hynes, Martin Lees y Jan Marco Müller - OCDE

https://www.oecd.org/content/dam/oecd/en/publications/reports/2020/02/systemic-thinking-for-policy-making_a95b3226/879c4f7a-en.pdf

Optimización con incertidumbre - Microsoft

https://www.microsoft.com/en-us/research/project/optimization-with-uncertainty/

Exploración de los límites de la detección fuera de distribución - Stanislav Fort, Jie Jessie Ren, Balaji Lakshminarayanan

https://research.google/pubs/exploring-the-limits-of-out-of-distribution-detection/

Superprof: la plataforma para encontrar los mejores profesores particulares en España.